NVIDIA B200 | H200

Testen Sie jetzt im MEGWARE Benchmark Center

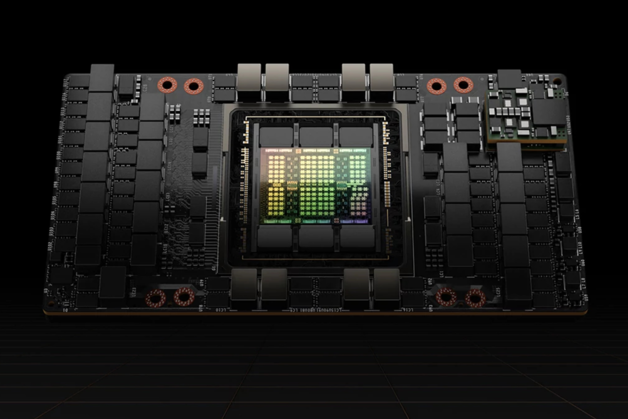

Die Grafikkarte für generative KI und HPC

Die NVIDIA H200-Tensor-Core-Grafikkarte bietet generative KI- und HPC (High-Performance Computing)-Workloads mit bahnbrechender Leistung und Speicherkapazität. Als erste Grafikkarte mit HBM3e treibt der größere und schnellere Speicher der H200 die Beschleunigung generativer KI und großer Sprachmodelle (LLMs) an und beschleunigt gleichzeitig wissenschaftliche Berechnungen für HPC-Workloads.

Mit der neuesten Blackwell B200 GPU bietet NVIDIA noch höhere Energieeffizienz, Bandbreite und Rechenleistung.

JETZT KOSTENLOS TESTEN

Technische Daten

| FP64 | 34 TF |

| FP64 Tensor Core | 67 TF |

| FP32 | 67 TF |

| TF32 Tensor Core | 989 TF |

| BFLOAT16 Tensor Core | 1.979 TF |

| FP16 Tensor Core | 1.979 TF |

| INT8 Tensor Core | 3.958 TOPS |

| GPU-Speicher | 141 GB |

| GPU-Speicherbandbreite | 4,8 TB/s |

| Max. Thermal Design Power (TDP) | bis zu 600 W (konfigurierbar) |

| Mehr-Instanzen-Grafikprozessoren | Bis zu 7 MIGs mit je 16,5 GB |

NVIDIA H200

NVL

| Formfaktor | PCIe |

| Konnektivität | 2- oder 4-Way-NVIDIA NVLink-Bridge: 900 GB/s PCIe Gen5: 128 GB/s |

Technische Daten

| FP64 | 34 TF |

| FP64 Tensor Core | 67 TF |

| FP32 | 67 TF |

| TF32 Tensor Core | 989 TF |

| BFLOAT16 Tensor Core | 1.979 TF |

| FP16 Tensor Core | 1.979 TF |

| INT8 Tensor Core | 3.958 TOPS |

| GPU-Speicher | 141 GB |

| GPU-Speicherbandbreite | 4,8 TB/s |

| Max. Thermal Design Power (TDP) | Bis zu 700 W (konfigurierbar) |

| Mehr-Instanzen-Grafikprozessoren | Bis zu 7 MIGs mit je 16,5 GB |

NVIDIA H200

für SXM

| Formfaktor | SXM |

| Konnektivität | NVLINK: 900GB/s PCIe Gen5: 128 GB/s |